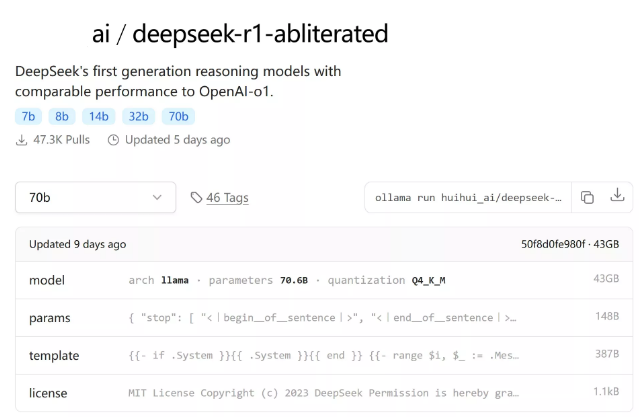

越狱版的DeepSeek R1现已托管在Hugging face上,支持8B、14B、32B 【链接直达】

配套教程网址

https://www.youtube.com/watch?v=L1QkuWK4U9g

可能有人会觉得越狱版没有官方版聪明,这是一个比较大的误解,官方版可是671B的,普通人是跑不起来的,大多数人能本地运行的都是7b、8b、14b、32b这几大类型的模型,是被蒸馏压缩过的,无法直接和671B相比,但是自己本地使用已足够。

DeepSeek-R1对显卡的需求取决于其参数大小。

对于1.5B和7B的模型,显卡并非必需,可以在没有GPU的情况下使用CPU进行推理。

如果需要GPU加速,可以选择消费级的GPU,如NVIDIA GTX 1650或RTX 3060(8-12 GB显存)

对于8B和14B的模型,需要高端GPU,如NVIDIA RTX 3090或A100(16-24 GB显存)

而对于32B和70B的模型,则需要专业级GPU,如NVIDIA A100或H100(32 GB+显存)

最大的671B模型则需要多GPU并行计算,例如多张A100或H1002。

此外,DeepSeek-R1还有动态量化版本,通过模型压缩技术降低了显存需求,适合家用电脑和移动设备

当然如果你有高级的硬件配置,你可以直接上70B的, 在Ollama 【链接直达】

本地部署越狱版步骤

1、下载并 安装Ollama 【点击下载】

2、在CMD终端下通过命令下载DeepSeek R1越狱版

7b

ollama run huihui_ai/deepseek-r1-abliterated:7b

8b

ollama run huihui_ai/deepseek-r1-abliterated:8b

14b

ollama run huihui_ai/deepseek-r1-abliterated:14b

32b

ollama run huihui_ai/deepseek-r1-abliterated:32b

70b

ollama run huihui_ai/deepseek-r1-abliterated:70b

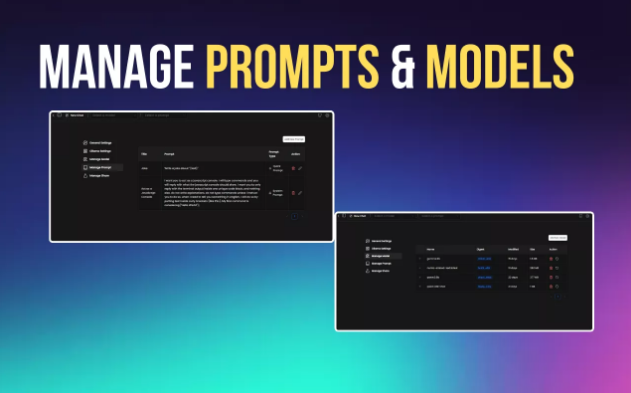

3、安装 Web UI

就可以本地调用 deepseek r1 越狱版 AI 大模型 【点击下载】

如果个人配置不适合可以选择第三方平台

华为与硅基流动合作的项目:进入

训练投喂 https://anythingllm.com/ 教程

分配说明:

Embedder首选项 选择qwen2.5 https://ollama.com/library/qwen2.5:1.5b

ollama run qwen2.5:1.5bhttps://ollama.com/library/nomic-embed-text

ollama pull nomic-embed-text

如有侵权,请联系 yao4fvip#qq.com (#改@) 删除。